O podmiotowości, znaczeniu i granicach tego, co może zostać zastąpione

AI zastąpi człowieka.

To zdanie powraca dziś w wielu wariantach — jako obietnica, ostrzeżenie lub wygodny skrót porządkujący debatę. Przy bliższym namyśle okazuje się jednak nie tyle kontrowersyjne, co nieprecyzyjne. Zastąpi którego człowieka — tego, który przetwarza informacje, czy tego, który doświadcza świata?

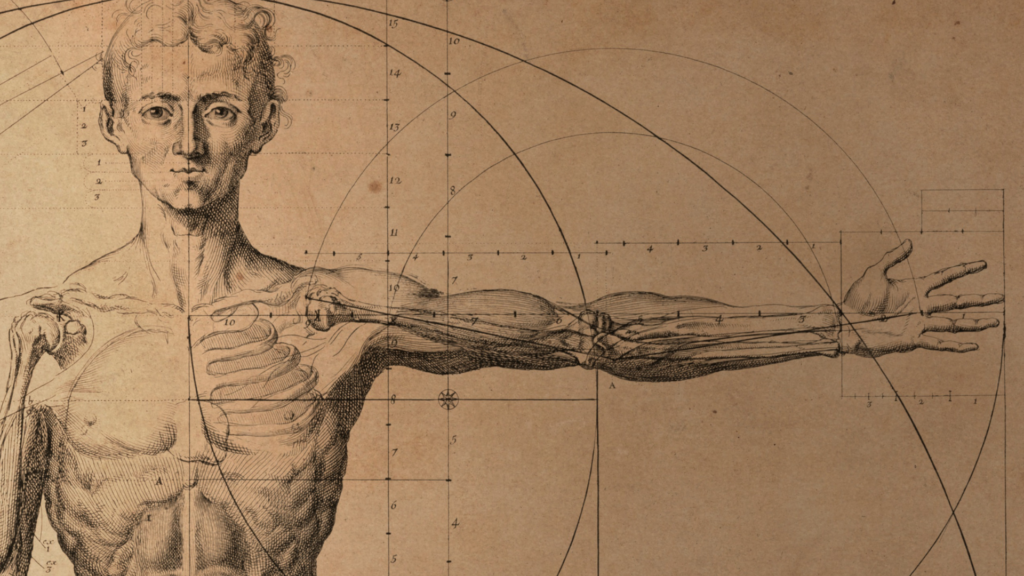

Współczesne systemy AI osiągają imponujące rezultaty, ponieważ operują dokładnie tam, gdzie człowiek jest najłatwiejszy do uchwycenia: na poziomie funkcji. Analiza danych, rozpoznawanie wzorców, generowanie języka — wszystko to można modelować, skalować i optymalizować. W tym sensie AI rzeczywiście zbliża się do tego, co można nazwać funkcjonalnym odpowiednikiem mózgu rozumianego jako system przetwarzania informacji.

Problem zaczyna się wtedy, gdy ten poziom uznajemy za wyczerpujący opis człowieka. Jeśli bowiem myślenie sprowadzimy do przetwarzania informacji, rozumienie do przewidywania, a język do statystycznej generatywności, człowiek staje się z definicji zastępowalny. Nie dlatego, że maszyna stała się człowiekiem, lecz dlatego, że człowieka opisano w sposób, który czyni go równoważnym maszynie.

Sedno problemu leży więc w rozróżnieniu, które zbyt łatwo uznajemy za oczywiste: mózg i umysł nie są tym samym, choć jedno bez drugiego nie istnieje. Mózg można opisać jako układ operacji — impulsy, sygnały, transformacje — i właśnie ten poziom zaczynamy coraz skuteczniej odtwarzać. Umysł nie jest jednak zbiorem operacji. Jest tym, w czym operacje stają się czymś dla kogoś.

To przejście — od procesu do doświadczenia — nie jest różnicą stopnia, lecz różnicą rodzaju. Nie istnieje żaden oczywisty most między tym, że system przetwarza informację, a tym, że coś znaczy. Można wyobrazić sobie system doskonale działający na poziomie „mózgu” — biologiczny lub sztuczny — być może nigdy — albo przynajmniej nieprędko, nie stanie się umysłem, nie dlatego, że czegoś mu brakuje ilościowo, lecz dlatego, że brakuje mu wymiaru, w którym świat w ogóle się pojawia.

Różnica ta staje się widoczna szczególnie wyraźnie tam, gdzie doświadczenie wymyka się redukcji. Śpiew ptaków można opisać jako strukturę częstotliwości, zachód słońca jako rozkład fal elektromagnetycznych, a zapach jako konfigurację molekularną. Żadna z tych reprezentacji nie jest jednak tym, co się wydarza, gdy ktoś tego doświadcza.

Łza pojawiająca się nagle podczas oglądania starego nagrania nie jest funkcją obrazu, lecz powrotem czasu.

Poczucie ulgi po podjęciu trudnej, ale sprawiedliwej decyzji nie wynika z optymalizacji bilansu zysków, lecz z odzyskania wewnętrznej spójności. Poczucie bezpieczeństwa w czyjejś obecności nie jest brakiem wykrytych zagrożeń, lecz niemierzalną więzią, która sprawia, że świat przestaje być obcy.

Wreszcie — metafizyczny lęk przed przemijaniem nie jest błędem w instynkcie przetrwania, lecz bezpośrednim dotknięciem własnej skończoności.

Zapach przywołujący dzieciństwo nie jest tylko bodźcem chemicznym, lecz strukturą pamięci istniejącą tylko dlatego, że ktoś ją przeżywa.

Podobnie jest z wymiarem etycznym. Rozpoznanie cierpienia jako wzorca to nie to samo, co doświadczenie, że czyjeś cierpienie ma znaczenie. Dla algorytmu etyka jest zbiorem brzegowych warunków optymalizacji — zestawem reguł, których nie należy łamać, by system pozostał „bezpieczny”. Dla umysłu etyka zaczyna się tam, gdzie pojawia się ciężar odpowiedzialności.

W tym sensie umysł nie tylko nadaje znaczenie, ale także ustanawia zobowiązanie. Kiedy człowiek mówi „kocham”, „przepraszam” lub „wybieram”, kładzie na szali swoją podmiotowość. Za słowem stoi sprawstwo, a za sprawstwem — gotowość do poniesienia konsekwencji. AI może wygenerować najpiękniejsze przeprosiny świata, ale są one puste, ponieważ maszyna nie posiada „ja”, które mogłoby poczuć wstyd, ani życia, które mogłoby ulec zmianie pod wpływem błędu. Różnica między systemem a podmiotem polega na tym, że maszyna operuje w świecie bez ryzyka. AI może „rozwiązać” dylemat moralny, ale nie może go „przeżyć”.

Współczesna AI nie jest podmiotem. Nie ma punktu widzenia ani stawki egzystencjalnej; nie uczestniczy w świecie, lecz operuje na jego reprezentacjach. Może opisać cierpienie, sklasyfikować je i wygenerować adekwatną odpowiedź, ale nie istnieje dla niej różnica między opisem cierpienia a cierpieniem, między symulacją wartości a ich doświadczeniem. Nie jest to brak, który można łatwo uzupełnić skalą czy złożonością — wydaje się raczej należeć do innego porządku.

Nie ma dziś podstaw, by twierdzić, że systemy AI uczestniczą w tym wymiarze — choć pytanie, czy kiedykolwiek mogłyby, pozostaje otwarte. Być może w odległej przyszłości pojawią się systemy, które przekroczą ten próg. Dziś jednak wszystko wskazuje na to, że operujemy wyłącznie na poziomie funkcjonalnym.

W tym świetle pytanie „czy AI zastąpi człowieka” okazuje się źle postawione. To, co może zostać zastąpione, to funkcje; to, co nie może, to podmiotowość. Paradoks polega na tym, że im bardziej zachwycamy się możliwościami AI, tym łatwiej redukujemy człowieka do tego, co w nim funkcjonalne, mierzalne i odtwarzalne. A wtedy odpowiedź staje się oczywista — nie dlatego, że maszyna osiągnęła poziom człowieka, lecz dlatego, że człowiek został opisany tak, by dało się go zastąpić.

„Beautiful mind” nie polega więc na zdolności do obliczeń. Polega na zdolności do nadawania znaczenia, zajmowania stanowiska i ponoszenia konsekwencji tego, co uznajemy za ważne. To jest przestrzeń, w której pojawia się umysł — i przestrzeń, której, jak dotąd, żadna maszyna nie przekroczyła.

W epoce AI potrzebujemy nie tylko lepszych modeli, lecz także większej precyzji w rozumieniu samych siebie. Jeśli bowiem zgubimy różnicę między mózgiem a umysłem, zagrożeniem nie będzie AI, lecz to, że przestaniemy wiedzieć, czym jest bycie człowiekiem.